Ewolucja informatyki od starożytności do ery AI i komputerów kwantowych

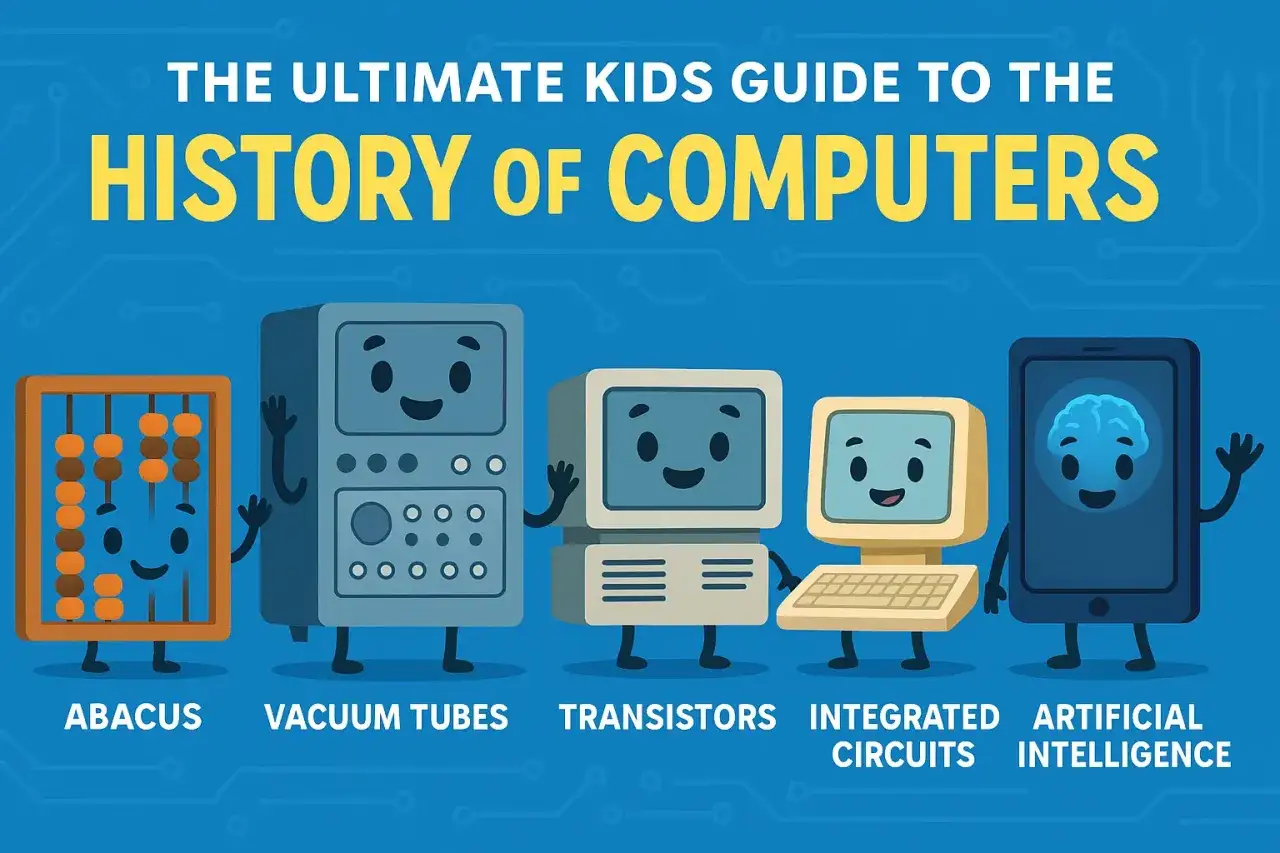

- Historia informatyki obejmuje drogę od abakusów, przez maszyny Babbage’a i Lovelace, po współczesne systemy AI.

- Kluczowe etapy to rozwój generacji komputerów (lampy, tranzystory, układy scalone, mikroprocesory).

- Ważne postacie to m.in. Ada Lovelace, Alan Turing, John von Neumann, oraz polscy pionierzy jak Jacek Karpiński.

- Polski wkład obejmuje Lwowską Szkołę Matematyczną, komputery Odra i innowacyjny K-202.

- Współczesna informatyka to era Internetu, sztucznej inteligencji, komputerów kwantowych i IoT.

Zrozumienie, skąd pochodzimy, jest często kluczem do zrozumienia, dokąd zmierzamy. W świecie technologii, który nieustannie pędzi do przodu, spojrzenie wstecz na historię informatyki staje się nie tylko fascynującą podróżą, ale i niezbędnym narzędziem do interpretacji teraźniejszości i prognozowania przyszłości. To właśnie dlatego uważam, że zgłębianie tej ewolucji jest dziś ważniejsze niż kiedykolwiek.

Dlaczego historia informatyki jest dziś ważniejsza niż kiedykolwiek?

W 2026 roku, gdy smartfony stały się przedłużeniem naszej dłoni, a zaawansowane systemy sztucznej inteligencji (AI) coraz śmielej wkraczają w każdą dziedzinę życia, łatwo zapomnieć, że fundamenty tego cyfrowego świata zostały położone dziesiątki, a nawet setki lat temu. Zrozumienie historii informatyki pozwala nam dostrzec, jak ewolucja technologii – od prostych narzędzi liczących, przez pierwsze maszyny mechaniczne, aż po dzisiejsze potężne komputery i algorytmy – kształtuje naszą codzienność w sposób, którego często nie jesteśmy świadomi. To nie tylko opowieść o wynalazkach, ale także o ludzkiej pomysłowości, uporze i dążeniu do przekraczania granic.

Lekcje płynące z przeszłości komputerów są nieocenione. Pozwalają nam nie tylko docenić innowacje, ale także zidentyfikować wzorce, unikać błędów, które popełniono wcześniej, i czerpać inspirację do tworzenia nowych rozwiązań. Kompleksowe i chronologiczne spojrzenie na ewolucję informatyki daje unikalną perspektywę, która pomaga lepiej zrozumieć obecne trendy, takie jak rozwój uczenia maszynowego czy komputery kwantowe, oraz wyzwania, z jakimi mierzy się współczesny świat, na przykład w kwestii bezpieczeństwa danych czy etyki AI. Właśnie dlatego ta podróż w czasie jest tak istotna – pozwala nam budować przyszłość na solidnych podstawach wiedzy o przeszłości.

Mechaniczne umysły: Kim byli ojcowie i matki założyciele informatyki?

Zanim komputery stały się elektroniczne, ich koncepcje rodziły się w umysłach wizjonerów, którzy wyprzedzali swoją epokę. Jednym z nich był Charles Babbage, brytyjski matematyk i wynalazca z XIX wieku. Jego wizja maszyny analitycznej, choć nigdy w pełni nie zbudowana za jego życia, zawierała wszystkie kluczowe elementy współczesnego komputera: jednostkę arytmetyczno-logiczną, sterowanie przepływem danych, pamięć i urządzenia wejścia/wyjścia. Był to projekt niezwykle ambitny, który wyznaczył kierunek dla przyszłych pokoleń.

Nie można mówić o Babbage’u bez wspomnienia o Adzie Lovelace, córce Lorda Byrona, która jest powszechnie uznawana za pierwszą programistkę w historii. Lovelace dostrzegła, że maszyna analityczna Babbage’a może wykraczać poza proste obliczenia i wykonywać złożone sekwencje operacji, czyli algorytmy. Stworzyła szczegółowe notatki opisujące, jak maszyna mogłaby obliczać liczby Bernoulliego, co jest uznawane za pierwszy algorytm przeznaczony do wykonania przez maszynę. Jej wkład był fundamentalny dla zrozumienia potencjału programowalnych maszyn.

W XX wieku pojawiła się kolejna kluczowa postać – Alan Turing. Brytyjski matematyk i logik, twórca koncepcji maszyny Turinga, abstrakcyjnego modelu komputera, który do dziś stanowi teoretyczną podstawę informatyki. Jego praca podczas II wojny światowej w Bletchley Park, gdzie odegrał kluczową rolę w łamaniu szyfrów Enigmy za pomocą maszyny Colossus, miała ogromne znaczenie dla aliantów i przyspieszyła rozwój elektronicznych maszyn obliczeniowych.

Kolejnym gigantem był John von Neumann, matematyk węgierskiego pochodzenia. To on sformułował architekturę von Neumanna, która stała się fundamentem dla niemal wszystkich współczesnych komputerów. Koncepcja ta zakłada przechowywanie zarówno programu, jak i danych w tej samej pamięci, co umożliwiło elastyczność i programowalność maszyn. Bez tej architektury, rozwój komputerów, jaki znamy, byłby niemożliwy.

Warto również wspomnieć o Konradzie Zuse, niemieckim inżynierze, który zbudował Z3 w 1941 roku – pierwszy w pełni funkcjonalny, programowalny komputer sterowany programem, wykorzystujący logikę binarną. Z kolei w Stanach Zjednoczonych, w 1945 roku, powstał ENIAC (Electronic Numerical Integrator and Computer) – pierwszy elektroniczny komputer ogólnego przeznaczenia, który ważył 30 ton i zajmował całe pomieszczenie, ale przetwarzał dane z niespotykaną dotąd szybkością.

Od szafy po kieszeń: Kluczowe generacje w rozwoju komputerów

Ewolucja komputerów, od gigantycznych maszyn po kieszonkowe smartfony, jest często dzielona na generacje, z których każda charakteryzuje się przełomową technologią, która zdefiniowała jej możliwości i zastosowania. To fascynująca podróż, która pokazuje, jak daleko zaszliśmy w ciągu zaledwie kilku dekad.

- Generacja I (lata 40. i 50. ): To era komputerów opartych na lampach elektronowych. Były to maszyny ogromnych rozmiarów, często zajmujące całe pomieszczenia, charakteryzujące się bardzo wysokim zużyciem energii i dużą awaryjnością. Przykładem jest wspomniany już ENIAC (1945), a także polski komputer XYZ, który był jednym z pierwszych polskich komputerów elektronicznych, zbudowanym na lampach. Programowanie odbywało się głównie za pomocą języka maszynowego, co było niezwykle złożone.

- Generacja II (lata 50. i 60. ): Przełomem było wynalezienie tranzystora. Ta niewielka, półprzewodnikowa struktura zrewolucjonizowała komputery, znacząco zmniejszając ich rozmiar, koszt i zużycie energii, jednocześnie zwiększając niezawodność. Komputery stały się bardziej dostępne dla biznesu i nauki, a programowanie zaczęło odbywać się w językach symbolicznych, takich jak asembler, oraz pierwszych językach wysokiego poziomu, np. Fortran.

- Generacja III (lata 60. i 70. ): Kluczową innowacją były układy scalone (Integrated Circuits – IC). Dzięki nim na jednej płytce krzemowej można było umieścić wiele tranzystorów, co doprowadziło do dalszej miniaturyzacji i wzrostu mocy obliczeniowej. To zapoczątkowało erę komputerów mainframe, które mogły obsługiwać wielu użytkowników jednocześnie i były wykorzystywane przez duże korporacje i instytucje rządowe. Pojawiły się systemy operacyjne i interaktywne terminale.

- Generacja IV (od lat 70. ): To era mikroprocesorów, czyli układów scalonych zawierających cały procesor na jednym chipie. Ten wynalazek doprowadził do rewolucji komputerów osobistych (PC), które stały się dostępne dla mas. Komputery takie jak Apple II czy IBM PC zmieniły sposób, w jaki ludzie pracowali, uczyli się i komunikowali. Rozwój graficznych interfejsów użytkownika (GUI) i sieci lokalnych (LAN) również miał tu kluczowe znaczenie.

- Generacja V (od lat 80. ): Ta generacja koncentruje się na rozwoju sztucznej inteligencji (AI), przetwarzaniu równoległym i zaawansowanych sieciach komputerowych. Celem stało się tworzenie komputerów, które potrafią naśladować ludzkie myślenie, uczyć się i rozumieć język naturalny. Rozwój Internetu i technologii mobilnych również wpisuje się w tę generację, prowadząc do powstania wszechobecnych i połączonych ze sobą systemów.

Aby lepiej zobrazować tę ewolucję, przygotowałem poniższą tabelę:

| Generacja | Lata | Kluczowa technologia | Charakterystyczne cechy | Przykłady/Przełomy |

|---|---|---|---|---|

| I | 1940s-1950s | Lampy elektronowe | Ogromne rozmiary, wysokie zużycie energii, duża awaryjność, programowanie w języku maszynowym | ENIAC, UNIVAC I, polski komputer XYZ |

| II | 1950s-1960s | Tranzystory | Mniejsze, szybsze, bardziej niezawodne, niższe zużycie energii, języki wysokiego poziomu (Fortran, COBOL) | IBM 7090, CDC 1604 |

| III | 1960s-1970s | Układy scalone | Dalsza miniaturyzacja, wzrost mocy obliczeniowej, systemy operacyjne, komputery mainframe | IBM System/360, DEC PDP-8 |

| IV | od 1970s | Mikroprocesory | Rewolucja komputerów osobistych (PC), graficzne interfejsy użytkownika (GUI), sieci lokalne | Apple II, IBM PC, Commodore 64 |

| V | od 1980s | Sztuczna inteligencja, przetwarzanie równoległe, sieci | Rozwój AI, uczenia maszynowego, komputery kwantowe, Internet, IoT | Superkomputery, smartfony, systemy AI, chmura obliczeniowa |

Polski ślad w cyfrowej rewolucji: Czy znasz te osiągnięcia?

Choć często skupiamy się na osiągnięciach gigantów z Doliny Krzemowej, Polska również ma znaczący wkład w rozwój informatyki, który zasługuje na uwagę. Już przed II wojną światową, Lwowska Szkoła Matematyczna, z takimi postaciami jak Jan Łukasiewicz, wniosła fundamentalne osiągnięcia w dziedzinie logiki. Jan Łukasiewicz jest twórcą odwrotnej notacji polskiej (ONP), znanej również jako notacja postfiksowa, która znalazła szerokie zastosowanie w informatyce, zwłaszcza w kompilatorach i kalkulatorach, dzięki swojej efektywności w przetwarzaniu wyrażeń arytmetycznych bez użycia nawiasów.

Jednym z najbardziej fascynujących, choć niestety niedocenionych projektów, był minikomputer K-202, stworzony przez genialnego inżyniera Jacka Karpińskiego na początku lat 70. K-202 był konstrukcją wyprzedzającą swoją epokę. Charakteryzował się niezwykłą szybkością, osiągającą około 1 miliona operacji na sekundę, co stawiało go w rzędzie najszybszych maszyn tamtych czasów. Posiadał również zaawansowane możliwości adresowania pamięci, co było rzadkością w tamtym okresie. Niestety, z powodów politycznych i organizacyjnych, projekt K-202 nie doczekał się masowej produkcji. Według danych Wikipedii, zbudowano jedynie około 30 sztuk tego komputera, co jest ogromną stratą dla polskiej, a nawet światowej informatyki, biorąc pod uwagę jego innowacyjność.

W okresie PRL, mimo trudności, polscy inżynierowie rozwijali również produkcję komputerów Odra w zakładach Elwro we Wrocławiu. Były to maszyny oparte na technologii tranzystorowej, wykorzystywane głównie w przemyśle, nauce i wojsku, które stanowiły podstawę polskiej informatyzacji w tamtych czasach.

Po 1989 roku polski rynek IT doświadczył dynamicznego rozwoju. Era komputerów Commodore, które trafiły pod strzechy polskich domów, zapoczątkowała masową edukację cyfrową. Dziś Polska jest znaczącym graczem w branży IT, zwłaszcza w sektorze gamedevu, z takimi firmami jak CD Projekt Red, które zdobyły globalne uznanie, pokazując, że polski duch innowacji wciąż jest żywy i ma wiele do zaoferowania światu cyfrowemu.

Kamienie milowe, które zdefiniowały współczesny świat

Poza ewolucją samych komputerów, istnieje szereg innych przełomów, które miały fundamentalny wpływ na kształt współczesnej informatyki i sposób, w jaki żyjemy, pracujemy i komunikujemy się. Te innowacje, często rozwijające się równolegle, wzajemnie się napędzały, tworząc złożony ekosystem cyfrowy.

Jednym z najważniejszych kamieni milowych było powstanie ARPANET w 1969 roku, sieci stworzonej przez amerykańską agencję ARPA (Advanced Research Projects Agency) do celów wojskowych i naukowych. Był to eksperymentalny projekt, który miał zapewnić komunikację nawet w przypadku częściowego zniszczenia sieci. Z czasem ARPANET ewoluował, a jego protokoły komunikacyjne (TCP/IP) stały się podstawą dla World Wide Web (WWW), wynalezionego przez Tima Bernersa-Lee w CERN-ie w 1989 roku. Narodziny globalnego Internetu, który znamy dzisiaj, otworzyły drzwi do bezprecedensowej wymiany informacji i zapoczątkowały erę cyfrowej globalizacji.

Równie istotna była ewolucja języków programowania. Od pierwszych, niskopoziomowych języków maszynowych i asemblera, przez Fortran i COBOL, które umożliwiły tworzenie bardziej złożonych programów, po nowoczesne języki, takie jak C++, Java, JavaScript czy Python. Każdy kolejny język oferował wyższy poziom abstrakcji, ułatwiając programistom tworzenie coraz bardziej zaawansowanych aplikacji i systemów. To właśnie dzięki nim możliwe stało się budowanie wszystkiego, od systemów operacyjnych po aplikacje mobilne i algorytmy sztucznej inteligencji.

Nie można również pominąć znaczenia wynalezienia graficznego interfejsu użytkownika (GUI). Chociaż jego korzenie sięgają badań w Xerox PARC w latach 70., to Apple Macintosh w 1984 roku, a później Microsoft Windows, spopularyzowały ideę ikon, okien i wskaźnika myszy. GUI zakończyło erę wiersza poleceń, czyniąc komputery znacznie bardziej intuicyjnymi i dostępnymi dla szerokiego grona użytkowników, którzy nie musieli już uczyć się skomplikowanych komend. To był kluczowy krok w demokratyzacji dostępu do technologii.

Jaka przyszłość nas czeka? Kierunki rozwoju informatyki na następne dekady

Patrząc na dynamiczną historię informatyki, naturalne jest zastanawianie się, co przyniosą kolejne dekady. Obecnie stoimy u progu kolejnych rewolucji, które mogą zmienić nasz świat w sposób równie fundamentalny, jak wynalazek Internetu czy komputerów osobistych.

Jednym z najbardziej obiecujących i jednocześnie budzących pytania kierunków jest rozwój sztucznej inteligencji (AI) i uczenia maszynowego. Algorytmy AI stają się coraz bardziej wyrafinowane, zdolne do analizowania ogromnych zbiorów danych, rozpoznawania wzorców, a nawet tworzenia treści. Pytanie, czy maszyny zaczną myśleć w sposób zbliżony do ludzkiego, pozostaje otwarte, ale ich wpływ na medycynę, transport, finanse i wiele innych dziedzin jest już niezaprzeczalny. AI to nie tylko automatyzacja, to także nowe narzędzia do rozwiązywania problemów, które dotychczas były poza naszym zasięgiem.

Innym, niezwykle ekscytującym obszarem są komputery kwantowe. Wykorzystując zasady mechaniki kwantowej, takie jak superpozycja i splątanie, komputery te obiecują moc obliczeniową, która może przekroczyć wyobraźnię i możliwości klasycznych maszyn. Choć wciąż są w fazie eksperymentalnej, ich potencjał w dziedzinach takich jak kryptografia, odkrywanie leków, modelowanie materiałów czy optymalizacja procesów jest ogromny. Mogą one rozwiązać problemy, które dziś są dla nas nierozwiązywalne.

Nie możemy zapomnieć także o koncepcjach takich jak Internet Rzeczy (IoT) i Big Data. IoT to wizja świata, w którym miliardy urządzeń – od smartfonów, przez inteligentne domy, po sensory przemysłowe – są ze sobą połączone i komunikują się, zbierając i wymieniając dane. Te ogromne ilości danych, czyli Big Data, stają się paliwem dla algorytmów AI, umożliwiając tworzenie inteligentnych miast, spersonalizowanej opieki zdrowotnej i efektywniejszych systemów zarządzania. To wizja świata, w którym wszystko jest połączone i napędzane danymi, co stwarza zarówno ogromne możliwości, jak i wyzwania związane z prywatnością i bezpieczeństwem.

Przyszłość informatyki to nie tylko nowe technologie, ale także nowe sposoby myślenia o interakcji człowieka z maszyną i o roli technologii w społeczeństwie. Jestem przekonany, że kolejne dekady przyniosą nam innowacje, które dziś trudno sobie nawet wyobrazić.